Su Reddit guida a come falsificare una identificazione a mezzo foto (come dimostrazione)

Il canale Reddit “Stable Diffusion”, dedicato alle Intelligenze Artificiali generative, ha pubblicato (tre volte) una guida come falsificare una identificazione a mezzo foto. Ad esempio usata da banche e affini, specialmente post-Pandemia, come alternativa all’identificazione di persona.

Su Reddit guida a come falsificare una identificazione a mezzo foto (come dimostrazione)

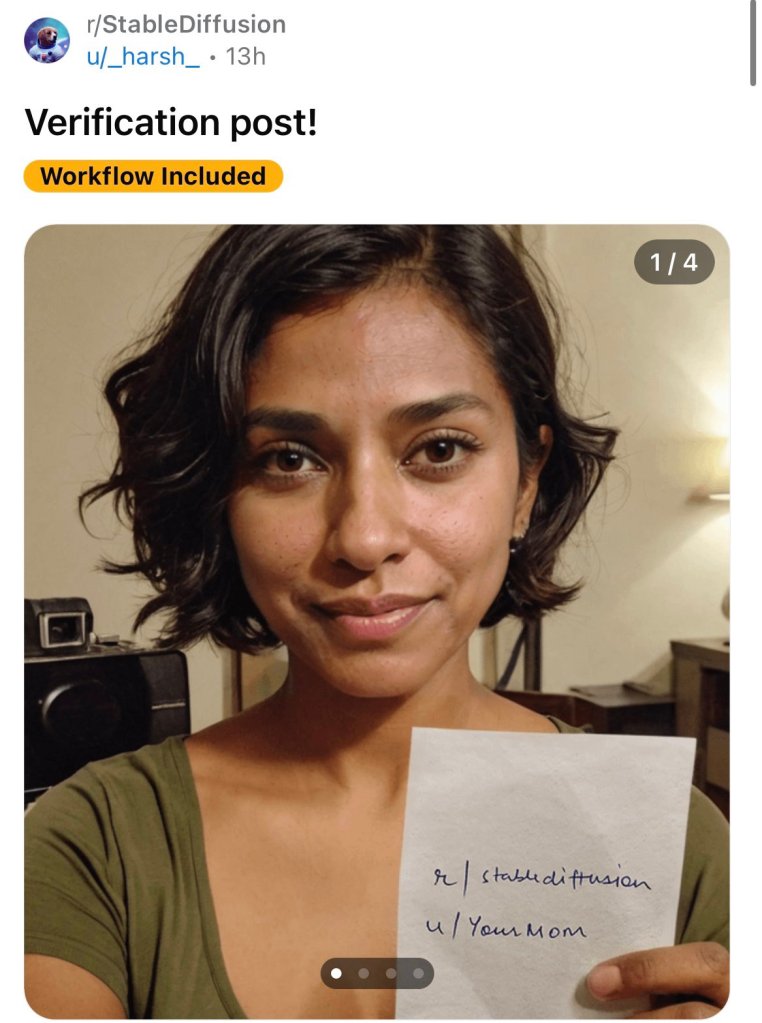

La screenshot che ci viene mostrata, facente parte di un post ora rimosso ma in seguito ripubblicato mostra una donna sorridente in posa con un biglietto con scritto il nome del subReddit.

Parliamo dell’identificazione cosiddetta “KYC”, “Know your Customer”, dove si chiede ad un potenziale cliente non in presenza di inviare una sua foto in posa con un documento di identità valido o delle scritte su un foglio di carta preapprovate dalle parti, foto che sarà poi controllata con sistemi per valutare manipolazioni.

Sistemi che vengono sfidati dalle AI.

Su Reddit guida a come falsificare una identificazione a mezzo foto (come dimostrazione)

Il “workflow”, o guida passo passo alla falsificazione prevede infatti dapprima la creazione di un viso di proprio gradimento, combinando dei modelli LoRA, per poi selezionare le migliori foto in cui il personaggio tiene in mano un foglio di carta bianco, o addirittura un documento.

Photoshop entrerà in scena in un secondo momento per riempire il foglio di carta con perizia e spingersi ad aggiungere scritte a pennarello sulla pelle del finto personaggio per dimostrare l’ulteriore grado di sofisticazione raggiunto dalla combinazione di AI e manipolazione umana.

Versione con documento

A questo punto si sarà ottenuto un modello che sia pur presentando alcuni tratti “sospetti” che abbiamo imparato a riconoscere, come sfondi sfocati e orecchie anomale risulta passabile ad una ispezione mediamente approfondita e che il progresso delle AI potrà rendere col tempo ancora migliore.

A questo punto, l’identificazione a mezzo fotografia rischia di diventare un orpello del passato, e con la possibilità di manipolare e creare anche dei video (cosa questa vista nella disinformazione filorussa) si dovrà presto tornare all’identificazione fisica, in filiale.

Se il nostro servizio ti piace sostienici su PATREON o

con una donazione PAYPAL.