Prima di ChatGPT: intelligenza artificiale anni ’80 (o giù di lì)

ChatGPT è ormai al centro delle vite virtuali di tutti e della cronaca. Per la grande utilità offerta da uno strumento che appare rivoluzionario, ma anche per numerosi fatti di cronaca che ne hanno evidenziato una serie di problemi.

I profili relativi alla privacy ed alla sicurezza del dato, casi in cui dati forniti da ChatGPT si sono rivelati non solo erronei, ma platealmente diffamatori e nocivi e persino il caso di un avvocato americano che, nel tentativo di subappaltare le ricerche giurisprudenziali all’Intelligenza Artificiale, è riuscito nell’impresa di trasformare una semplice causa civile per risarcimento danno in un’umiliante gogna.

Prima di ChatGPT: intelligenza artificiale anni ’80 (o giù di lì)

O i problemi dati da Dall-E e gli altri sistemi per generare invece immagini, ormai banditi da molti editori perché accusati di fare “Photobashing”, rubare pezzi di immagine di qua e di là dando l’illusione della creazione e sfruttando il lavoro creativo degli artisti.

Ma in realtà gli antenati di Intelligenze Artificiali esistevano da molto più tempo, da prima di Internet.

Avevamo già computer in grado di discorrere amabilmente con l’utente, di batterlo a scacchi, di intrattenerlo e persino di simulare una vera e propria personalità.

Come funziona ChatGPT rispetto ai suoi antenati

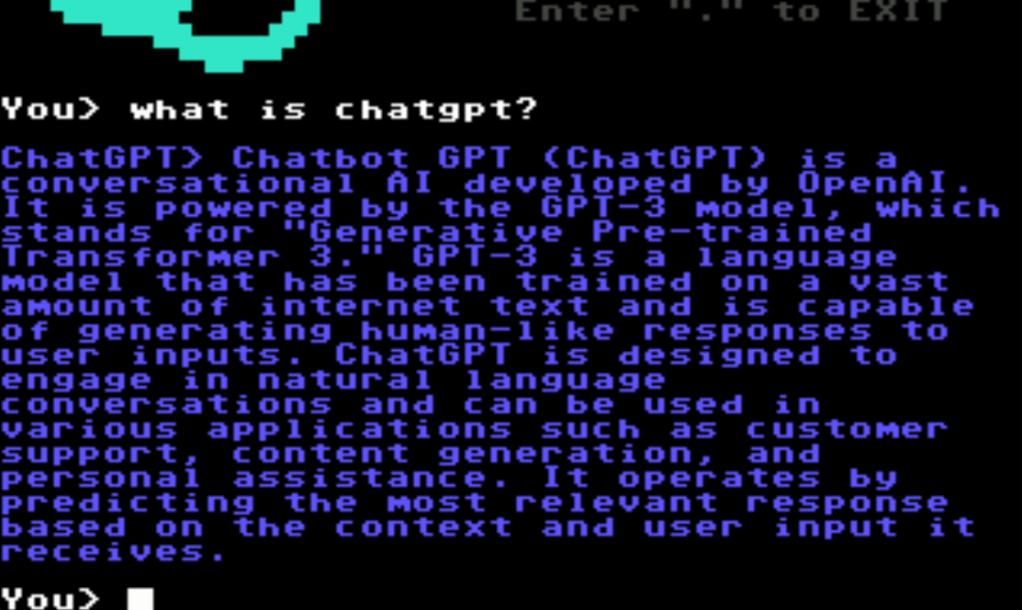

ChatGPT, nella sua forma attuale è un modello di lingua basato sull’architettura GPT (Generative Pre-trained Transformer). Viene nutrito da una enorme quantità di testi, la totalità di quanto prodotto sulla Rete in un determinato periodo e vagliato dai suoi creatori (motivo per cui Elon Musk ha sbarrato l’accesso alle AI) “imparando” a estrarre informazioni rilevanti, comprendere il contesto e usarle per generare risposte coerenti, ulteriormente migliorabili con le interazioni accumulate nel tempo.

Questo assai semplicemente e banalmente, riducendo la portata innovativa dei modelli GPT alla base.

Parimenti DALL-E e simili aggiungono la capacità di associare ai testi le immagini, anche esse da un corposo database prelevato da un database di informazioni provenienti dalla Rete, traducendo quindi i “Prompt”, i testi, in immagini.

Abbiamo ad esempio provato a chiedere a Dall-E di prepararci un’ipotetica mascotte. Non è venuta benissimo, ma passabile

Una ipotetica mascotte fatta da Dall-E

Ciò posto, l’umanità ha sempre cercato di creare un’intelligenza artificiale, creata da sé, con cui discutere. E in fondo il più elaborato modello di intelligenza artificiale non si discosta da quanto ipotizzato da Alan Turing e pubblicato nel 1950.

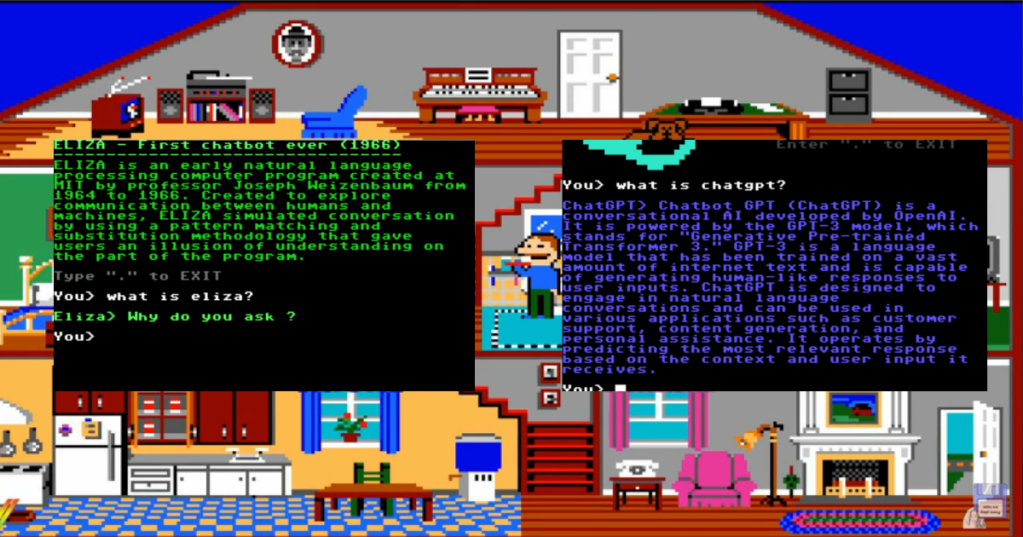

Dal “Turco” alla macchina di Turing

Prima delle intelligenze artificiali, un semplice modo per impressionare il pubblico, noto sin dall’antichità classica erano gli automi, fantocci meccanici in un certo senso, molto lato, programmabili.

I loro ingranaggi compivano movimenti che potevano essere cambiati con un minimo input dall’utente illudendo il pubblico di star guardando una creatura se non senziente in grado di obbedire: un automa del 1206 era poco più di un carillon con dei piccoli pupazzetti: cambiando i pernetti su una ruota che attivava i musicisti, essi suonavano melodie diverse muovendosi in modo grossomodo coerente con la musica.

Lo stesso Leonardo da Vinci si dilettò ad ipotizzare fantocci meccanici che, posti dentro un’armatura, ne avrebbero periodicamente agitato le braccia.

Si tratta ovviamente di inganni: quando i Giapponesi costruirono i loro automi nel 1800 li chiamarono non a caso “Karakuri Ningyo”, “I Burattini che ingannano”.

L’automa era sostanzialmente un burattino senza fili con un ingranaggio che ripeteva movimenti estremamente gradevoli, dando l’illusione del movimento cosciente, ma non una intelligenza artificiale (anche se, come vedremo, c’è un filo comune).

Riproduzione del Turco, un presunto automa

Il desiderio di creare una intelligenza altra fece nascere il “Turco”, un automa particolarmente elaborato che però nascondeva un compartimento per essere “pilotato” da uno scacchista umano.

Si trattava di un inganno nell’inganno, che però espresse il desiderio di intelligenza artificiale e i tentativi di codificarne il concetto prima che esso potesse esistere.

Una intelligenza artificiale, descrisse Turing, è tale non quando provi l’ineffabile e indescrivibile moto dell’autonoma intelligenza, ma quando interagendo con una IA non capisci se sei di fronte ad un essere umano o un inganno.

Un automa per quanto elaborato non passa il test di Turing: può solo ripetere azioni meccaniche all’infinito. Molte delle “Proto-Intellligenze” che vedremo in questa breve cavalcata hanno sempre dei segnali che “Danno via l’inganno”.

Una vera IA dovrebbe riuscire a mantenere la sceneggiata.

Il test di Turing e il test della Stanza Cinese

Immaginiamo tre giocatori, A, B, e C.

A è un uomo, B una donna e C un terzo individuo, non è importante di che sesso sia, che si pregi di poter identificare A e B se vi parlasse di persona.

A e B si chiudono in due stanze chiuse, e il loro scopo è imitarsi a vicenda in modo che C vada in confusione e confonda A con B. C quindi indovinerà alcune volte e sarà ingannato altre.

Una “bambola robot” giapponese

Ad un certo punto A o B viene rimpiazzato da una intelligenza artificiale: l’IA supererà il test se il numero di volte in cui C viene tratto in inganno sarà costante anche col nuovo partecipante (e naturalmente non si accorgerà dello scambio).

Nel 1980 il filosofo John Searle propose un “aggiornamento” del test, la “Stanza Cinese”.

Ipotizziamo non più un uomo, una donna e un “giudice”, ma un giudice a cui viene detto che dietro la stanza ci sia un individuo che parla fluentemente cinese, lingua di cui è madrelingua.

La premessa è sbagliata: dietro il paravento c’è una persona che non conosce una parola di cinese ma ha a disposizione dei vocabolari ed un frasario. Il giudice gli allunga dei pizzini con domande in cinese, il nostro soggetto armato di frasario, grammatica e dizionario risponde al volo con una frase perfettamente coerente.

Se ci riesce ha superato il test: è funzionalmente indistinguibile da un madrelingua Cinese. O quasi.

Vi risparmieremo tutte le obiezioni psicologiche e filosofiche ad entrambi i test, dalla “risposta del robot” alle “altre menti”. Capirete che esiste un filo conduttore tra l’automa giapponese in grado di porgere una tazza da the senza romperla, il “presunto cinese” e la “presunta donna”.

In tutti i questi casi lo stesso Turing paragonava l’effetto ad un pappagallo: un pappagallo può ripetere con convinzione delle parole, ma non significa e possa intrattenere un discorso.

ChatGPT e i suoi vari antenati possono rispondere correttamente a delle frasi, anche imbastire una risposta (o inventarsene una di sana pianta se non hanno dati), ma non significa che “conoscano” o abbiano intelligenza in senso umano.

Possono simularla quasi perfettamente.

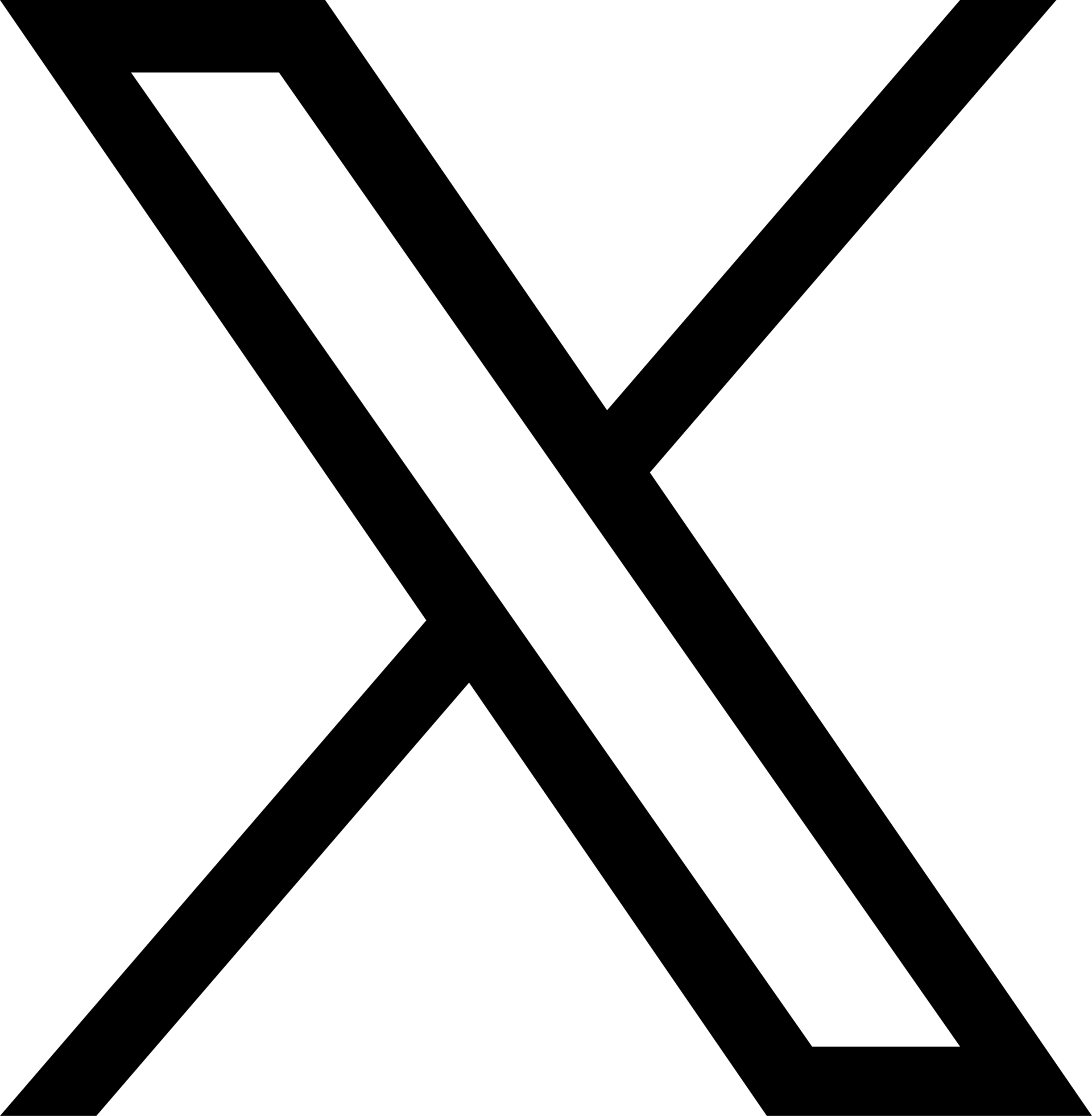

Intelligenze a 8 bit: Eliza

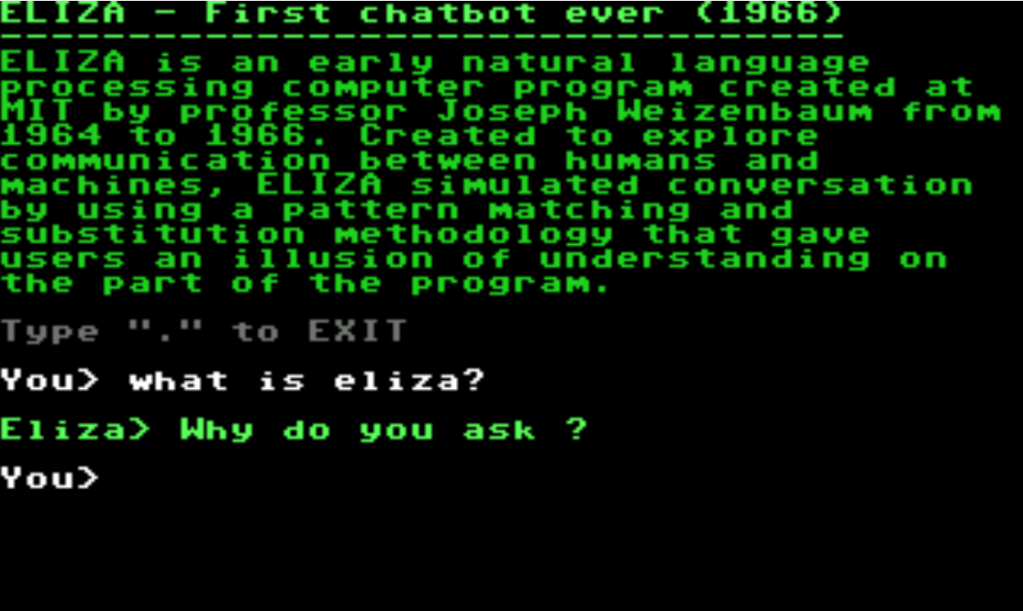

Il primo chatbot “moderno” della storia si chiamava Eliza. E ancora si chiama, dato che è possibile accedervi ancora in molti modi.

Eliza fu scritto nel 1966 da Joseph Weizenbaum, un informatico tedesco sedicente “Eretico della Tecnologia” che applicò un metodo linguistico ad uno stereotipato modello di un terapista rogersiano.

La “cornice narrativa” di una pseudoterapeuta virtuale assai stereotipata consentiva a Eliza di riciclare le frasi dette dall’utente. Dicendo ad Eliza “Oggi ho mal di testa” ad esempio Eliza ti risponderebbe con “Davvero? Ti fa male la testa?”, per proseguire con frasi tipo “Hai un atteggiamento positivo, vuoi parlarne?”.

Di fatto Eliza prendeva frasi inserite come input nel suo sistema, cercava parole chiave e le trasformava in output: come la parodia di uno psicoterapeuta trasformava domande in altre domande, nell’unico contesto in cui non solo è credibile, ma è anche considerato accettabile ed educato “rispondere ad una domanda con una domanda”.

Esempio di domanda posta ad Eliza su Retrocampus

Lo stesso nome di Eliza deriva dalla protagonista del musical “My Fair Lady”, un’ignorante fioraia dall’accento vernacolare che, esposta ripetutamente al linguaggio colto di due improvvisati precettori che scommettono sulla sua intelligenza, impara ad esprimersi coi modi forbiti ed eleganti di una gran dama della società elegante Londinese.

In realtà non è che Eliza potesse davvero “imparare”, ma era costruita per usare le frasi dell’interlocutore contro di lui. Se dovessimo darle per forza “l’apparenza di una personalità”, ChatGPT è in grado di scimmiottare uno studente svogliato che quando non ha argomenti inventa un pacco di ca**ate da ammanire al professore per non fare scena muta, Eliza una ragazza alquanto annoiata da quello che le stai dicendo ad un appuntamento che, non riuscendo più a seguirti, si limita ad annuire e rispondere con qualche saltuario “Davvero?”, “Oh, è molto interessante, continua pure a dire quello che stavi dicendo prima”.

Per il 1966 l’illusione era perfetta: le prime iterazioni di Eliza sono infatti precedenti al computer moderno, in un’epoca in cui era del tutto accettabile comunicare col computer usando una telescrivente, oggetto nato per comunicare messaggi di testo attraverso la rete telegrafica e poi usato come antenato del Terminale per comunicare con un computer.

Di solito bastavano pochi minuti per costringere Eliza ad “avvitarsi su se stessa” (per lo stesso motivo per cui, postulando una sua “controparte umana” come una giovane donna distratta dalle scemenze che stai raccontando, puoi accorgerti dell’inganno chiedendole del dinosauro che le ha rubato la macchina per sentirti rispondere “Sì, certo, certo, interessante, continua… cosa avete fatto tu e il velociraptor?”) e quindi per farle fallire il test di Turing: ma in quei pochi minuti avevi l’illusione che ci fosse dall’altro lato della telescrivente un’entità in grado di comunicare in modo a te simile.

La stessa domanda posta a ChatGPT, interfaccia a 8bit offerta da RetroCampus per Commodore 64

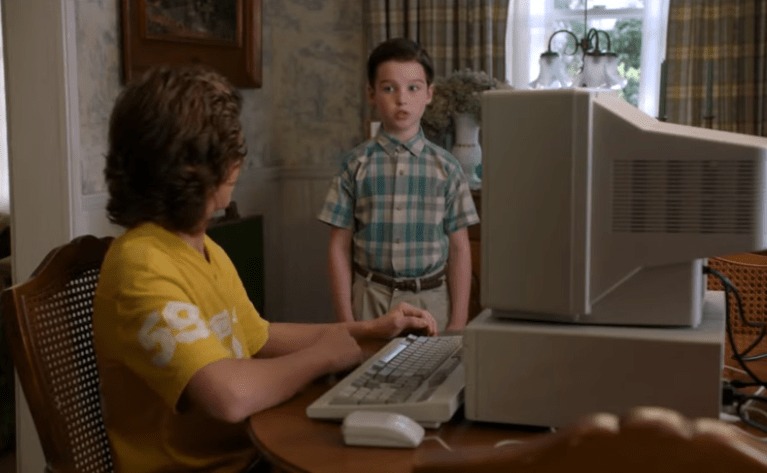

Eliza fu poi “portato” su altri computer più “moderni”, come il Commodore 64, l’Apple II e persino i primi computer a 16 Bit. Memorabile la sua apparizione in “Young Sheldon”, serie TV ambientata negli anni ’90, in un episodio in cui il giovane Sheldon Cooper, brillante ragazzino del Texas, convince suo padre a regalargli un computer Tandy 1000 (con MS-DOS) per aiutarlo negli studi e finisce a chiedere ad Eliza come fare a far cessare le liti tra il padre desideroso di accontentarlo e la madre preoccupata per il costo del computer, mentre il meno intelligente fratello George “Georgie” Cooper decide di provare a sedurre Eliza con scarso successo.

Evento questo parodia dell'”effetto Eliza”, il fenomeno psicologico nel quale si attribuisce ad una IA più intelligenza e sentimento di quelli realmente posseduti, cosa che si traduce in un vero e proprio investimento emotivo, quando non alla “personalizzazione” di un computer visto non più come oggetto, ma come un proprio pari dotato di emozioni e personalità.

Scena da Young Sheldon

Un programma assai simile ad Eliza apparve nel 1991 assieme alle schede audio Soundblaster, chiamato “Dr. Sbaitso”. Il Dottore univa i trucchetti linguistici di Eliza alla capacità delle schede audio di produrre voci umane “convincenti”, ancorché gracchianti e prive di intonazione.

Come Eliza, il dottor Sbaitso poteva essere costretto a ripetersi, ma poteva essere mandato in crash costringendolo a dire parolacce e bestemmiare: essendo determinate parole non comprese nel suo programma, avrebbe portato ad un “parity Error”.

Se ChatGPT si limita ad ammonirti dicendo di “non poter creare contenuti volgari”, o minacciare di segnalarti agli admin, Dr. Sbaitso aveva una crisi di nervi sul posto autodistruggendosi.

Giocare a scacchi con un computer intelligente come una calcolatrice programmabile, e perdere

Programmi scacchistici come la serie di Sargon Chess, Colossus Chess, Chessmaster 2000 e il più umile ma divertente Battle Chess (dove gli scacchi si animano creando divertenti scenette tra una mossa e l’altra) portarono nelle case emozioni paragonabili allo scontro iconico tra Kasparov e Deep Blue del 1997.

Anche in questo caso essere battuti da un Apple II o da un Commodore 64 non vi rendeva particolarmente stupidi, ma era una funzione di come le intelligenze artificiali di programmi iconici come Sargon e Colossus valutavano le mosse da compiere.

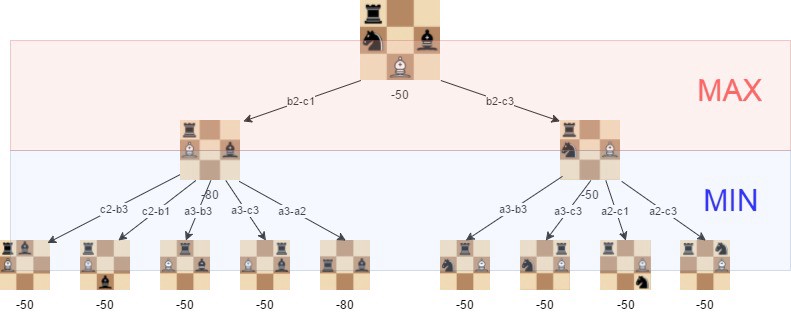

Esempio di algoritmo Minimax, fonte Freecodecamp

Partendo da una vera e propria banca dati di mosse apparse nei tornei e nelle competizioni, un programma per gli scacchi era in grado di usare un algoritmo chiamato Minimax: valutando quindi dopo ogni mossa sottoposta dall’avversario la possibile migliore contromossa e le possibili migliori contromosse dell’avversario cui far seguire la possibile migliore contromossa… in una sorta di albero frattale delle possibilità che simulava la capacità di un campione di valutare non solo la mossa, ma la “contromossa”.

Ovviamente la differenza tra un PC moderno ed un computer degli anni ’80 traspare.

Dal punto di vista teorico un Macbook Pro, partendo dalle stesse condizioni di un Amiga 500, detto in modo semplice, vede molte più mosse nel suo futuro, ha un database più vasto a cui viene sommato il sapere di un altro paio di generazioni di esseri umani ed ha maggior velocità e capacità di calcolo per applicare quelle decisioni.

Dal punto di vista tecnico l’attore, influencer e maker Christian Simpson ha orchestrato uno scontro tra un Amiga 500 e un computer Apple moderno ottenendo alcuni scenari in cui il computer degli anni ’80 riusciva a prevalere.

Macbook contro Amiga, fonte YouTube

Dal punto di vista umano, è come avere un anziano “scacchista da parco” che grazie alla sua esperienza riesce a battere una giovane promessa fresca di studio dei manuali e con qualche vittoria nei circuiti locali sotto la cintura.

In una nuova sfida, tra un Amiga 1200 con Chessmaster 2000 (la “Cadillac” dei programmi dell’epoca) e Swordfish il computer moderno ha invece vinto due volte su due in una sfida “Al meglio dei tre”, dimostrando quanto la capacità di autoapprendimento possa fare la differenza.

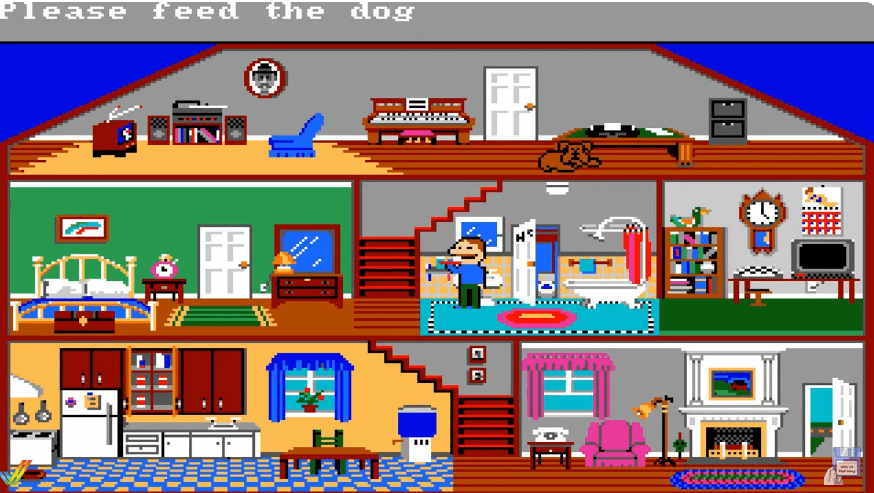

La “AI” a portata di mano “Little computer People”

Il giocattolo più interessante in grado di simulare intelligenza e investimento economico era però Little Computer People, gioco Activision precursore di The Sims e in grado di simulare investimento emotivo ed un dialogo costante col giocatore umano.

Nella “storia cornice” con cui Activision vendeva il gioco, disponibile per diversi computer prodotti tra gli anni ’80 e ’90 ed in una versione semplificata per il Famicom, il NES giapponese, alcuni scienziati avevano scoperto che in ogni computer vive un tenero ometto in una casa, che ne rappresenta in qualche modo l’anima vitale.

Lo stesso materiale promozionale descriveva la “costosa scoperta” fatta da un gruppo di scienziati su come stimolare l’omino (nella versione Giapponese per Famicom, una bambina col suo gattino) a palesarsi, diventando tuo amico ma affidando a te la sua esistenza, rendendoti quindi il nuovo ricercatore incaricato del benessere e dello studio delle attività della bizzarra creaturina intelligente nel tuo computer.

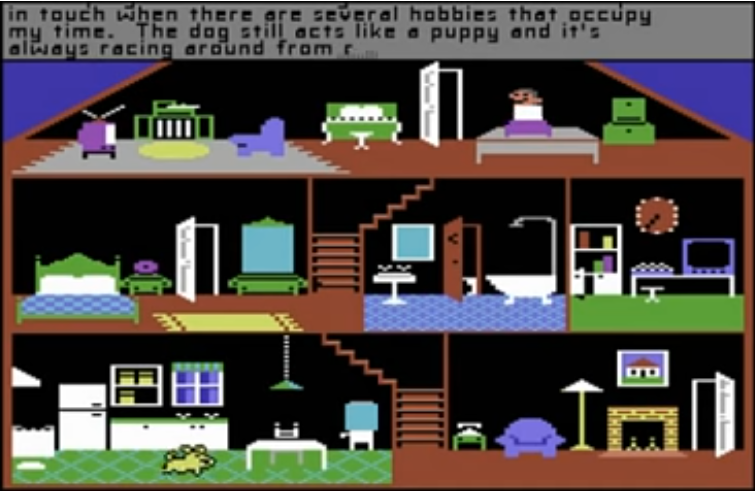

Grazie al floppy (o alla cassetta) di LCP diventa così interagire con l’omino, uno diverso per ogni computer esistente al mondo. L’omino vive in una casetta che noi vediamo in spaccato, simile ad una casa di bambole, con un simpatico cagnolino (naturalmente raffigurato nei limiti della grafica dell’epoca) che scorrazza per le stanze e gli tiene compagnia.

Schermata di Little Computer People, versione Commodore 64, fonte YouTube

Il tuo scopo diventa fornirgli il necessario per vivere: acqua, cibo, dei dischi (siamo pur sempre negli anni ’80) per distrarlo consentendogli di ascoltare musica.

Se il povero omino non riceve cibo ed acqua, diventerà verdognolo e malaticcio, passando il suo tempo a letto e scrivendo lettere chiedendo aiuto e risorse, parimenti se annoiato chiederà un po’ di tempo per la tua compagnia fino a tornare a esprimerti la sua felicità sia con espressioni facciali che con eloquenti e ben composte lettere.

Se felice, infatti userà la stessa macchina da scrivere installata in un ufficetto nell’attico per ringraziarti, raccontandoti i suoi “sentimenti”. Ad esempio dicendo di sentirsi appagato e in forma, al sicuro e che il cagnolino lo rallegra tanto quanto la tua compagnia.

Premettendo la parola “Please” prima di ogni richiesta potrai chiedere all’omino di suonare per te una melodia al pianoforte, giocare a carte con te (e si complimenterà per ogni mossa riuscita) o interagire.

Come per Eliza e simili una serie di trucchetti rendevano le discussioni con l’omino assai coerenti. In memoria LCP aveva una serie di “frammenti di frasi”, che venivano collegati tra loro a seconda dei parametri relativi a cibo, acqua e svago.

In ogni lettera l’omino prendeva frammenti di frase legati alla sua condizione, derivata direttamente dalle interazioni col suo “ricercatore umano”, aggiungendo una sezione “flusso di coscienza” legata ad una varietà di mattoncini adatti a creare frasi dall’illusione di essere sempre nuove, grammaticalmente correnti e rilevanti rispetto agli eventi mostrati in scena, presenti e pregressi.

Ad esempio un omino ben pasciuto potrebbe scrivere una cosa tipo

Caro amico, non potrei essere più felice. Grazie a te ho sempre cibo in abbondanza, non devo preoccuparmi di niente. Il mio cane si comporta ancora come un cucciolo, e scorrazza per casa. Finché avrò te a darmi una pacca ogni tanto e il mio cane non sentirò mai la solitudine. Potrei avere un disco? Forse mi annoio un po’.

Oppure

Caro amico, mi sento un po’ giù. La mia dispensa è vuota, e presto non avrò niente da mangiare. Potresti mandarmi qualcosa, sono abbastanza preoccupato e temo di non farcela senza il tuo aiuto

Con ogni frase presente in un numero di variazioni previste dall’autore in modo da scrivere lo stesso concetto in diversi modi durante i giorni successivi, identificando parole chiave nelle tue richieste in modo da rendere le sue interazioni e risposte sensate.

Laddove Eliza veniva scoperta in pochi minuti, un ragazzino avrebbe cominciato a notare la natura meccanica delle interazioni con “l’omino del PC” solo dopo diversi tentativi, facendo in tempo a formare un legame emotivo col suo nuovo amico, rinforzato dal fatto che il suo benessere era di fatto nelle sue mani.

Come per ChatGPT, ma naturalmente in modo più rudimentale, l’omino poteva associare le tue parole alle sue richieste, ovvero a termini “connessi” alla banca dati in suo possesso. In modo superiore a Eliza, ma inferiore a ChatGPT ovviamente.

Little Computer People, versione Amiga

Altri “sporchi trucchi” prevedevano salvare il gioco quando l’omino era in bagno, in modo che sia il personaggio umano che il cagnolino sparissero dalla “casa di bambole” evitando rallentamenti per spezzare l’illusione, o la generazione di un nome ed un aspetto diverso (di fatto i colori di maglietta e pantaloni, nelle versioni per Amiga anche pettinatura ed eventuali accessori) a seconda di un numero di codice unico scritto nel floppy, rendendo quindi ogni omino diverso da quello degli altri.

Un omino trascurato poteva gravemente ammalarsi e “morire”: si sarebbe steso a letto senza più rialzarsi, ma spedendo il floppy ad Activision sarebbe stato copiato un nuovo floppy con lo stesso codice (comprare un nuovo floppy avrebbe creato un nuovo omino) in un servizio noto come “La Clinica dei Little Computer People” che avrebbe ridato la salute al vostro simpatico amico.

Obiettivo che per alcune versioni, come quella Amiga o Commodore 64, può oggi essere ottenuto con programmi esterni.

LCP era noto per portare l’effetto Eliza al suo massimo, stimolandoti a prenderti cura dell’omino e del suo buffo cagnetto cercando di mantenerli felici, in salute e amichevoli ad ogni attivazione del gioco.

Concludendo

L’uso delle intelligenze artificiali in campo sia ludico che utilitario ha fatto enormi passi avanti.

Potrete anche voi, come abbiamo fatto nell’articolo, provare ad interrogare “ChatGPT a 8bit” passando da Retrocampus BBS per valutare le differenze con Eliza, e pensare agli enormi passi avanti fatti da Eliza ad oggi.

Se il nostro servizio ti piace sostienici su PATREON o

con una donazione PAYPAL.